visionOS 1.0: Was uns das SDK über Apple Vision Pro verrät

Apple hat Simulator und Software Development Kit für die Vision Pro veröffentlicht. Neben einem optischen Vorgeschmack gibt es auch interessante Neuigkeiten.

Mit so viel Spannung ist wohl selten ein Software Development Kit erwartet worden wie das von Apples erstem räumlichen Computer, Vision Pro. Wer sich vom ersten visionOS-Simulator, der am Mittwochabend veröffentlicht wurde, kleine Fundstücke und weitere Einblicke erhofft, wird dann auch nicht enttäuscht. Schon binnen des ersten Tages sind Entwickler und andere Interessierte auf einige Neuigkeiten und Details gestoßen, die Apple bislang nicht öffentlich kommuniziert hat.

Der Weg zum Simulator führt wie bei Apples anderen Entwickler-Tools über einen Developer-Account – wobei für diesen Zweck nicht einmal die bezahlte Variante (100 Euro pro Jahr) nötig ist – und die Programmierumgebung Xcode. Wer sich von der Developer-Seite die mehrere Gigabyte große Beta 2 von Xcode 15 heruntergeladen hat, muss nach dem ersten Starten noch einmal 7,35 Gigabyte für das visionOS 1 SDK laden, bevor es losgehen kann. Interessante Randnotiz: Wer den Simulator auf Apples Seite einzeln herunterlädt, stößt im Titel des komprimierten Archivs auf die Bezeichnung „xrOS 1.0“ – der ursprünglich vermutete Name von Apples Mixed-Reality-Betriebssystem. Da xrOS auch einige Male in der Entwickler-Keynote State of the Union aufblitzte, hat die Marketingabteilung ihre Entscheidung für den Namen visionOS offenbar sehr kurzfristig getroffen.

So viel Vision Pro steckt im Simulator

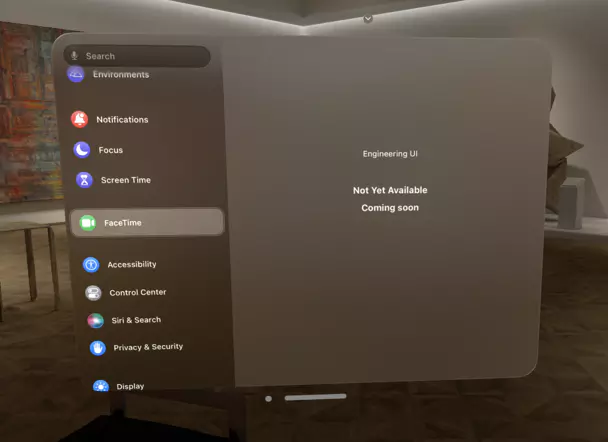

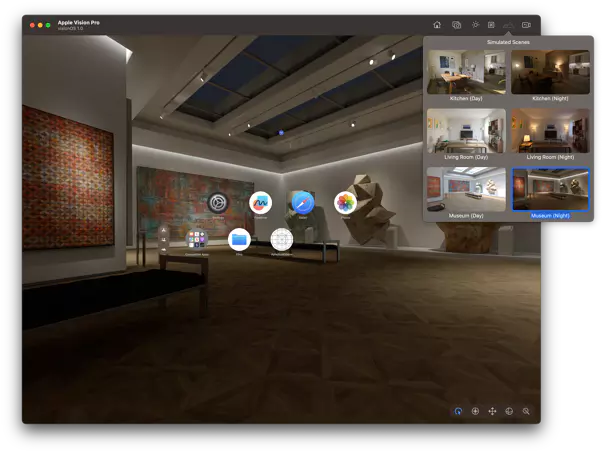

Wer gleich zum Simulator durchstarten möchte, muss nur eine leere visionOS-App anlegen und kann dann unter Auswahl des Simulators diesen mit der App starten. Sogleich ist der markante neuartige Home-Screen des Headsets zu sehen. In dem Simulator stehen auch einige System-Apps der Vision Pro bereit: Dazu zählen die noch recht neue Gestaltungs-App Freeform, der Safari-Browser, Fotos, iCloud Dateien und die Einstellungen.

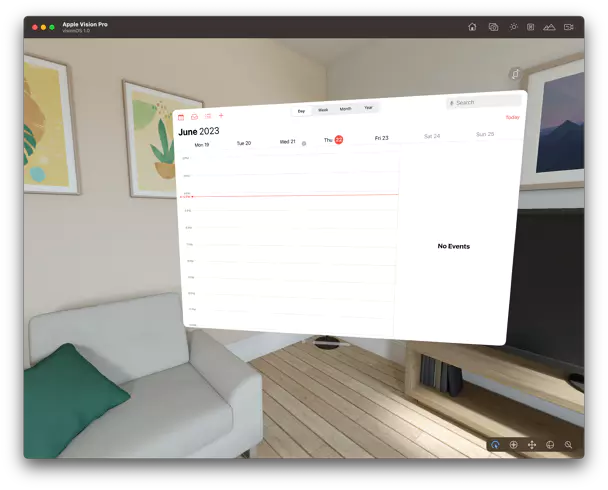

Weitere bekannte System-Apps, nämlich Kalender, Karten, Apple News, Erinnerungen und Kurzbefehle, hat Apple in einem Ordner „Kompatible Apps“ hinterlegt. Das heißt, dass sie als iPad-Apps vorliegen und noch nicht optimiert wurden. Vermutlich dürfte Apple die eine oder andere App davon noch in einer eigenen visionOS-Variante vorlegen.

iPad-Apps mit Abstrichen

Dass sich der Aufwand lohnt, die eigene App für visionOS anzupassen, betonen bereits einige Entwickler von Dritt-Apps und es ist auch anhand der System-Apps gut nachzuvollziehen: iPad-Apps sind zwar nahezu vollwertig einsetzbar, sie stechen aber mit ihrem typischen iPad-Design deutlich heraus. visionOS-Apps bieten geschmeidigere Übergänge und mit ihrer Milchglas-Oberfläche passen sie viel besser zum räumlichen Erlebnis.

Bei der Nutzung von iPad-Apps auf der Vision Pro gibt es laut Apples Entwicklerdokumentation neben der Optik noch einige weitere Einschränkungen. So stehen unter anderem Gesundheitsdaten aus HealthKit nicht zur Verfügung, was anzeigt, dass Apple zumindest zum Auftakt auch keine Health-App und Gesundheitsfunktionen vorsieht. Schon absehbar waren Einschränkungen beim Gebrauch der Kameras, da diese aus Sicherheitsgründen nicht App-Entwicklern frei zur Verfügung stehen sollen. Auch auf Sensorendaten wie vom Barometer müssen Entwickler verzichten. Es dürften also einige iPad-Apps nur eingeschränkt auf der Vision Pro nutzbar sein.

Neue Steuerelemente

Neuartig dürfte für Nutzer, die vom iPhone oder iPad kommen, die Steuerung der Fenster sein. Unten befinden sich ein kleiner Punkt und eine längere Linie. Die Linie ist von iPhone und iPad als App-Switcher im Multitasking bekannt. Auf der Vision Pro dient sie aber dazu, die Fenster im Raum zu verschieben. Der kleine Punkt erweitert sich zum Schließen-Button, um zur Hauptansicht zurückzukehren. Allerdings kann auch die digitale Krone hierfür gedrückt werden – an ihre Stelle tritt im Simulator der Home-Button im App-Fenster.

Neben den genannten System-Apps finden sich auch Funktionen wie Sprachassistent Siri, die Möglichkeit, die Arbeit mit mehreren Fenstern zu arbeiten, und das Kontrollzentrum im ersten Simulator. Ein Wiedersehen gibt es auch mit der leicht schräg dargestellten Bildschirmtastatur, die in Developer-Sessions der WWDC schon einmal in Erscheinung getreten war.

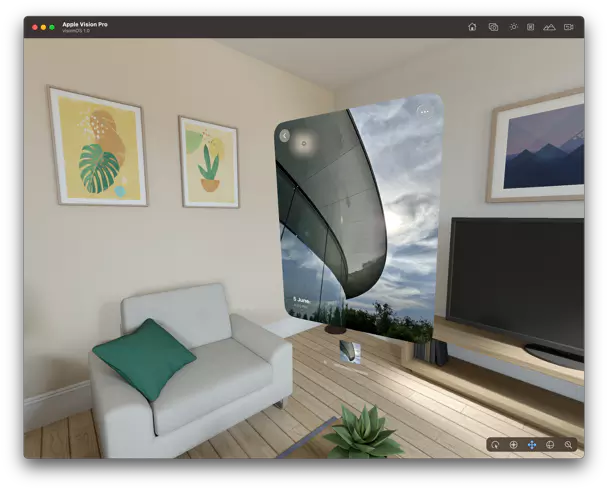

Eine größere Auswahl von sogenannten Environments, also Bildumgebungen, die dazu dienen, die reale Welt im Sichtfeld zu überdecken, gibt es auch. Allerdings sind diese bislang im Simulator offenbar noch nicht benutzbar. Per digitaler Krone können diese Environments auf der Vision Pro wie eine Art Vorhang im Raum ausgebreitet werden.

Outdoor? Im Moment eher nicht

Auf ihre echte Realität müssen Nutzer des Simulators verzichten. Dafür stehen ihnen verschiedene Räume zur Auswahl, die Apple in der App hinterlegt hat. Diese liegen jeweils in einer Tag- und einer Nachtversion vor. Neben einem Wohnzimmer und einer Küche ist dies ein Museum. Es fällt auf, dass ein Outdoor-Szenario komplett fehlt, was den vorhandenen Eindruck verstärkt, dass Apple sein Headset vorerst primär für den Gebrauch in geschlossenen Räumen vorsieht.

Gastmodus und visuelle Suche

Zwei weitere Entdeckungen stecken in den Tiefen des Simulators und drängen sich dem Betrachter nicht ohne Weiteres auf. Zum einen wurde ein Gastmodus entdeckt, der es wohl ermöglichen soll, die ansonsten personalisierte Brille auch anderen Personen zur Nutzung zu geben. Die größte Hürde dürfte freilich die Hardware sein, die mit dem individuell eingestellten Kopfband und den bei Brillenträgern persönlichen magnetischen Linseneinsätzen vermutlich schwieriger weiterzugeben ist.

Zum anderen wurde eine visuelle Suchfunktion entdeckt, die Text im Sichtfeld des Nutzers automatisch erfasst und zum Beispiel in Echtzeit übersetzen kann. Diese Funktionen hat Apple als Live Text auf dem iPhone in iOS 16 eingeführt – schon damals ist vermutet worden, dass es sich um eine vorbereitende Maßnahme für ein Headset handeln könnte, wo diese Funktion die Interaktion mit der Umgebung ermöglicht.

Hands-On und Showcase in München

Soviel der Simulator bereits zeigt und ermöglicht: In den kommenden Monaten wird für Entwickler neben der Theorie auch die Praxis wichtig sein. Wer wie der Autor zu denjenigen gehört, die die Vision Pro schon einmal tragen durften, kann mit Bestimmtheit sagen, dass das Simulator-Erlebnis allenfalls an der Oberfläche kratzt.

Obwohl die Vision Pro Anfang 2024 erst mal nur in den USA erscheint, wird Apple mit Ingenieuren schon im Juli in München vor Ort sein und die Hardware in geschlossenen Veranstaltungen zum Testen mitbringen. Dass der iPhone-Hersteller schon den nächsten Schritt des globalen Roll-Outs im Blick hat, zeigt sich auch an den Developer-Showcases. So war schon bei der WWDC die DJ-App djay zu sehen. Karim Morsy, Chef von Algoriddim, der Firma, die djay entwickelt, gehörte zu den ersten, die anhand ihrer Apps zeigen durften, wie die Vision Pro für Entwickler eingesetzt werden kann. Seine App dürfte nach Veröffentlichung des SDK zum Start der Vision Pro im Jahr 2024 sicher nicht mehr die einzige aus Europa